Open WebUI 是什麼?打造個人化 AI 助手的強大新選擇

Table of Contents

Open WebUI 是什麼?

最近,您是不是也跟許多人一樣,對那些能跟我們對話、寫文章、甚至畫圖的 AI 工具感到非常好奇?但往往在實際操作時,發現介面複雜、安裝不易,或是功能受限,實在有點讓人洩氣。別擔心!如果您也曾遇到這樣的困擾,那麼您一定不能錯過 **Open WebUI**。簡單來說,Open WebUI 就是一個開源、易於使用的網頁介面,它能讓您輕鬆地與各種大型語言模型 (LLMs) 進行互動,就像在跟一位非常聰明的個人助理聊天一樣!

想像一下,您不需要懂複雜的程式碼,也不需要經歷漫長的安裝設定,就能在自己的電腦上,或是透過雲端,啟動一個專屬於您的 AI 聊天機器人。這就是 Open WebUI 想帶給您的體驗。它最棒的地方在於,它能整合多種不同的 AI 模型,讓您可以自由切換,找到最適合您需求的「腦袋」。無論您是想讓它幫您寫報告、 brainstorm 點子,還是單純想找個人聊聊天,Open WebUI 都能辦到!

Open WebUI 的核心魅力:為何它如此引人注目?

在眾多 AI 介面工具中,Open WebUI 之所以能脫穎而出,關鍵在於它提供了幾個令人驚豔的特色。它不僅僅是一個簡單的聊天視窗,更是一個功能強大、高度客製化的平台。

直覺易用的使用者介面 (UI)

這是 Open WebUI 最直觀的優勢。對於不熟悉技術細節的使用者來說,一個友善的介面至關重要。Open WebUI 的設計秉持「使用者至上」的原則,乾淨、簡潔的佈局,讓您可以迅速上手。您不需要翻閱厚厚的使用手冊,就能輕鬆找到您需要的功能。對話視窗清晰明瞭,輸入訊息、查看回覆都非常流暢,就像您平常使用即時通訊軟體一樣自在。

支援多元 AI 模型

Open WebUI 的強大之處,在於它並非綁定於單一 AI 模型。它支援多種主流的開源 LLMs,例如 Llama 2、Mistral、Vicuna 等等。這意味著您可以根據自己的需求和偏好,選擇不同的模型來驅動您的 AI 助理。例如,您可能發現某個模型在寫程式方面表現出色,而另一個模型則更擅長創意寫作。有了 Open WebUI,您就可以像更換手機 App 一樣,輕鬆切換不同的「大腦」,體驗不同模型的獨特風格和能力。

這點對於需要進行特定任務的使用者來說,尤其重要。假設您是一位需要大量撰寫行銷文案的創作者,您可以挑選在文案生成上表現優異的模型;如果您是一位需要處理大量程式碼的研究者,則可以選擇更適合程式開發的模型。這種靈活性,大大提升了 AI 工具的實用性。

本地部署的彈性與安全性

對於注重隱私和數據安全的使用者而言,Open WebUI 的本地部署能力是一大福音。您可以選擇將 Open WebUI 安裝在自己的電腦或伺服器上,這樣您所有的對話和數據都將保留在您的掌握之中,無需擔心敏感資訊外洩。這對於企業或個人來說,提供了極高的安全保障。

本地部署的好處,不僅在於安全性,更在於其彈性。您可以完全掌控運行環境,不受外部服務商的限制。對於擁有高性能硬體的使用者來說,運行本地模型可以獲得更快的反應速度和更低的延遲,帶來絕佳的使用體驗。

開源社群的活力

作為一個開源專案,Open WebUI 受益於全球開發者的貢獻。這意味著它不斷地被更新、優化,並且有活躍的社群提供支援。當您遇到問題時,很有可能在社群論壇或 GitHub 上找到解答。此外,開源的特性也鼓勵了創新,許多新功能和整合,往往會由社群成員率先提出和實現。

Open WebUI 的安裝與設定:一步步帶您上手

雖然 Open WebUI 旨在讓使用變得簡單,但初次接觸時,了解基本的安裝步驟還是很有幫助的。以下為常見的安裝方式,這裡以 Docker 為例,因為它能大幅簡化環境配置的複雜度,讓您快速啟動。

使用 Docker 快速部署 (推薦)

Docker 是一個非常流行的容器化平台,它能將應用程式及其所有依賴打包在一起,方便在任何地方運行。使用 Docker 安裝 Open WebUI,能確保您的環境與開發者的環境一致,減少許多「在我的電腦上可以跑」的問題。

必備條件:

- 已安裝 Docker 和 Docker Compose。

- 對終端機 (Terminal) 有基本的操作概念。

步驟:

-

建立專案目錄:

在您的電腦上選擇一個方便的位置,建立一個新的資料夾,例如 `open-webui-docker`。 -

建立 `docker-compose.yml` 檔案:

在剛剛建立的 `open-webui-docker` 資料夾內,建立一個名為 `docker-compose.yml` 的文字檔案。 -

編輯 `docker-compose.yml`:

將以下內容複製貼入 `docker-compose.yml` 檔案中。這裡的設定,是讓 Open WebUI 能夠運行,並且掛載必要的設定檔和模型資料夾。version: '3.8' services: web: image: ghcr.io/open-webui/open-webui:main # 使用官方最新的 Image container_name: open-webui ports: - "3000:8080" # 將主機的 3000 port 映射到容器的 8080 port volumes: - open-webui-data:/app/backend/data # 持續化儲存,以免資料丟失 - ./models:/app/models # 掛載本地模型資料夾 (如果需要本地模型) environment: - OLLAMA_BASE_URL=http://host.docker.internal:11434 # 如果您使用 Ollama 運行模型,需要此設定 # - OPENAI_API_KEY=YOUR_OPENAI_API_KEY # 如果您使用 OpenAI API Key # - AZURE_OPENAI_API_KEY=YOUR_AZURE_OPENAI_API_KEY # 如果您使用 Azure OpenAI # - AZURE_OPENAI_ENDPOINT=YOUR_AZURE_OPENAI_ENDPOINT # - AZURE_OPENAI_DEPLOYMENT_NAME=YOUR_AZURE_OPENAI_DEPLOYMENT_NAME restart: unless-stopped volumes: open-webui-data: external: true # 確保資料卷持續存在 name: open-webui-data # 如果您打算使用 Ollama 運行本地模型,則需要額外啟動 Ollama 服務 # 註解掉 Ollama 的部分,表示您將另外啟動 Ollama container 或已在主機上運行 # services: # ollama: # image: ollama/ollama:latest # container_name: ollama # ports: # - "11434:11434" # volumes: # - ollama-data:/root/.ollama # restart: unless-stopped # volumes: # ollama-data: # external: true # name: ollama-data -

建立模型資料夾 (可選):

如果您打算將模型檔案下載到本地,以便 Open WebUI 直接存取,請在 `open-webui-docker` 資料夾內建立一個名為 `models` 的子資料夾。 -

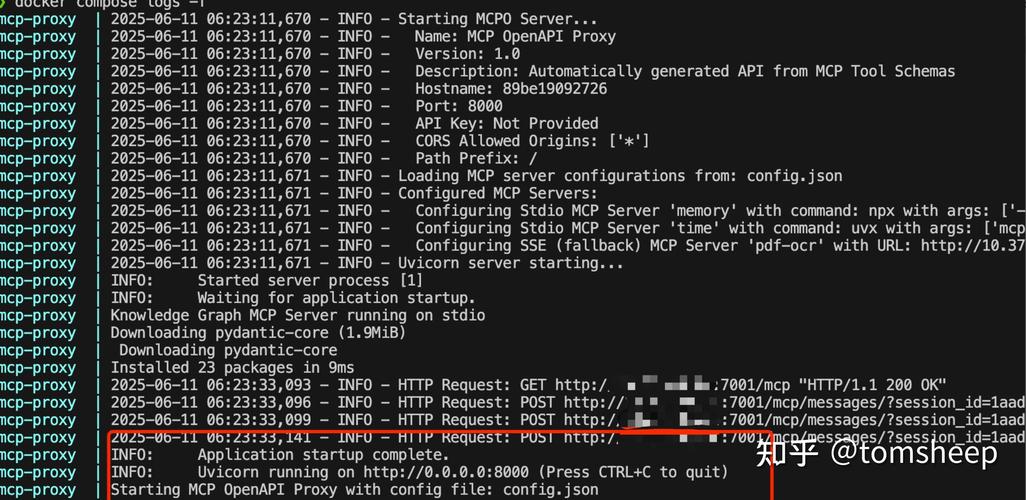

啟動 Open WebUI:

打開您的終端機,進入 `open-webui-docker` 資料夾,然後執行以下指令:docker-compose up -d`-d` 參數表示讓容器在背景運行。

-

存取 Open WebUI:

打開您的網頁瀏覽器,輸入 `http://localhost:3000`。您應該就能看到 Open WebUI 的登入畫面了。 -

首次登入與設定:

第一次登入時,您需要註冊一個帳號。建立帳號後,您就可以開始設定 AI 模型了。

重要提示:

上面的 `docker-compose.yml` 檔案提供了一個基本的設定。

- 如果您計畫使用 Ollama 來運行本地模型,請取消註解 Ollama 的部分,並確保 `OLLAMA_BASE_URL` 設定正確。

- 如果您想使用 OpenAI 或 Azure OpenAI 的 API,請根據您的 API Key 和端點資訊,修改對應的 `environment` 變數。

- `volumes` 的設定非常重要,它確保了您的設定和下載的模型不會因為容器重啟而丟失。

關於模型的使用

Open WebUI 本身不包含 AI 模型,它是一個介面。您需要透過其他方式來獲取模型,並讓 Open WebUI 能夠存取。常見的方式有:

- 使用 Ollama: Ollama 是一個非常方便的工具,讓您可以在本地輕鬆下載和運行多種開源 LLMs。您可以在 Ollama 的官網下載並安裝。安裝完成後,您可以使用 `ollama run llama2` 等指令來下載和啟動模型。

- API 串接: 您可以直接透過 OpenAI, Azure OpenAI, 或其他提供 API 服務的模型廠商,在 Open WebUI 中輸入您的 API Key 來使用他們的模型。

Open WebUI 的實際應用場景

瞭解了 Open WebUI 的功能和安裝方式後,我們來看看它到底能為我們做些什麼,讓我們的生活和工作變得更有效率、更有趣。

個人化 AI 助理

這絕對是 Open WebUI 最核心的價值。您可以根據自己的習慣和偏好,設定一個專屬的 AI 助理。

- 寫作助手: 無論是撰寫部落格文章、電子郵件、社群媒體貼文,甚至是詩歌、劇本,都可以請 AI 幫您構思、潤飾,甚至代筆。您可以針對特定風格或語氣提出要求,讓 AI 產出更符合您需求的內容。

- 學習夥伴: 遇到不懂的概念?需要快速了解一個新領域的資訊?直接問您的 AI 助理!它可以幫您解釋複雜的學術理論,總結大量的資料,或是出考古題來測試您的學習成效。

- 創意發想: 卡關了?需要一些新點子?和 AI 腦力激盪吧!您可以描述您的專案或問題,讓 AI 提供不同的角度和建議,激發您的創意靈感。

- 程式開發輔助: 對於程式設計師來說,AI 助手可以幫您撰寫程式碼片段、除錯、解釋程式碼邏輯,甚至將一種程式語言轉換為另一種。

知識管理與查詢

您可以將 Open WebUI 當作一個高度智慧化的知識庫。

- 文件摘要: 上傳長篇的文件(如 PDF、TXT),請 AI 快速為您摘要重點,節省閱讀時間。

- 資訊搜尋: 雖然現在有許多搜尋引擎,但有時候您需要的不是單純的網頁連結,而是經過整理、分析過的答案。Open WebUI 能夠整合多方資訊,直接提供您整合性的回答。

- 個人筆記整理: 如果您習慣用文字記錄想法,可以將這些筆記輸入 AI,請它幫您分類、歸納,找出其中的關聯性,形成更結構化的知識體系。

娛樂與創意

AI 不僅僅是工具,也能帶來樂趣。

- 角色扮演: 想像一下,您在和一位歷史人物、一位文學角色,甚至是一個虛構的生物對話。Open WebUI 的靈活性,讓您可以設定 AI 的「個性」,創造出意想不到的互動。

- 故事創作: 您可以與 AI 一起編織一個故事,您寫一句,AI 接下一句,共同創作出引人入勝的冒險。

- 生成圖像: 許多大型語言模型也整合了圖像生成的能力(例如透過 Stable Diffusion 等模型)。您可以用文字描述您想要的畫面,讓 AI 為您「畫」出來。

Open WebUI 的進階設定與技巧

當您對 Open WebUI 的基本操作感到熟悉後,一些進階的設定和技巧,能讓您的 AI 體驗更上一層樓。

精準的 Prompts 工程

AI 的能力,很大程度上取決於您給予它的「指令」(Prompts)。學習如何撰寫清晰、具體的 Prompts,是讓 AI 發揮最大潛力的關鍵。

- 明確角色設定: 在 Prompts 中明確告知 AI 應該扮演的角色,例如「請你扮演一位資深新聞編輯…」、「假設你是一位歷史學家,請解釋…」。

- 指定輸出格式: 告訴 AI 您期望的輸出格式,例如「請用條列式列出」、「請提供一個表格」、「請以 Markdown 格式輸出」。

- 提供範例 (Few-shot learning): 如果您希望 AI 模仿某種寫作風格或回答模式,可以在 Prompts 中提供幾個範例,讓 AI 學習。

- 限制條件: 設定輸出內容的長度、包含或排除的關鍵字、語氣風格等。

自訂系統提示 (System Prompt)

在 Open WebUI 的設定中,通常會有「系統提示」或「角色」的選項。這裡您可以輸入一段比較長的、全局性的指示,來定義 AI 的整體行為模式、知識範圍或個性。這比每次對話都輸入相同的指令來得更有效率。

管理和切換模型

如果您同時掛載了多個模型(例如透過 Ollama 下載了 Llama 3、Mistral、Code Llama 等),您可以在 Open WebUI 的介面中輕鬆切換它們。這個過程非常直觀,您只需要在聊天介面中選擇您想要使用的模型即可。

使用 API Key 串接雲端模型

對於需要更強大、更廣泛知識的模型,或者您的本地硬體資源不足時,串接雲端的 API 是一個很好的選擇。

- OpenAI API: 如果您有 OpenAI 的帳號和 API Key,可以在 Open WebUI 的設定中輸入,就能使用 GPT-3.5 或 GPT-4 系列的模型。

- Azure OpenAI Service: 對於有 Azure 帳戶的用戶,也可以設定 Azure OpenAI 的相關參數,來使用微軟提供的 OpenAI 模型。

請務必妥善保管您的 API Key,不要隨意洩漏,以防產生額外費用。

常見問題與疑難解答

Q1:Open WebUI 需要很強的電腦才能跑嗎?

這取決於您打算如何使用 Open WebUI,以及您想要運行什麼樣的 AI 模型。

- 僅作為介面,連接雲端 API: 如果您打算主要使用 OpenAI 或 Azure OpenAI 等雲端模型的 API,那麼 Open WebUI 本身對硬體的要求非常低,一般的筆記型電腦或桌上型電腦都能順暢運行。

- 運行本地開源模型: 如果您希望在本地運行大型語言模型(如 Llama 2, Mistral 等),那麼對硬體的要求就會顯著提高。這主要取決於模型的「大小」(參數數量)和您的「顯示卡 (GPU)」的記憶體 (VRAM)。通常來說,要順暢運行較大的模型,您可能需要一張擁有至少 8GB VRAM 的顯示卡,若要運行更先進或更大參數的模型,12GB、16GB,甚至 24GB VRAM 的顯示卡會是比較理想的選擇。

幸運的是,Ollama 等工具也支援在 CPU 上運行模型,雖然速度會比 GPU 慢很多,但對於一些較小的模型,也能提供基本的體驗。

Q2:我下載的模型在哪裡?我能自己管理模型檔案嗎?

是的,您可以自行管理模型檔案。在我們前面提到的 Docker 設定中,有一個重要的部分是 `volumes`,例如 `./models:/app/models`。

- `./models` 是您在主機(也就是您的電腦)上建立的資料夾。

- `/app/models` 是容器內 Open WebUI 預設讀取模型檔案的路徑。

透過這樣的掛載,您下載到主機 `./models` 資料夾中的模型檔案,Open WebUI 就能夠讀取。您可以直接將模型檔案(例如 .gguf 格式的模型)放入這個資料夾,然後在 Open WebUI 的模型設定中選擇使用。

如果您是使用 Ollama 來下載模型,Ollama 通常會有自己的模型儲存路徑(可以在 Ollama 的設定中查看),Open WebUI 透過 `OLLAMA_BASE_URL` 設定連結到 Ollama,間接就能存取 Ollama 管理的這些模型。

Q3:Open WebUI 的安全性如何?

Open WebUI 本身是一個開源專案,安全性依賴於開發團隊的努力和社群的監督。

- 本地部署的安全性: 當您選擇本地部署時,您的資料都在您的掌控之下,這大大降低了資料外洩的風險,相比於將敏感資訊上傳到第三方伺服器,本地部署通常是更安全的選擇。

- API Key 的保護: 如果您使用 API Key 來串接雲端模型,請務必保護好您的 API Key,不要在公開場合暴露,也不要在不信任的環境中輸入。

- 定期更新: 就像任何軟體一樣,定期更新 Open WebUI 到最新版本,可以確保您獲得最新的安全修補程式,防範已知的安全漏洞。

總體來說,只要您遵循良好的安全實踐(如保護 API Key、定期更新),Open WebUI 是一個相對安全的工具。

Q4:我可以在手機上使用 Open WebUI 嗎?

可以,只要您的 Open WebUI 伺服器是可從您的手機網路訪問的。

- 本地網路: 如果您的 Open WebUI 運行在家裡的電腦,並且您的手機連接到同一個 Wi-Fi 網路,您就可以透過瀏覽器,輸入伺服器 IP 位址加上 Open WebUI 的埠號(例如 `http://192.168.1.100:3000`)來存取。

- 遠端訪問: 如果您想在任何地方都能使用 Open WebUI,您需要進行一些網路設定,例如設定路由器進行埠轉發 (port forwarding),或是使用更進階的 VPN 或反向代理服務。這需要一些網路知識,操作時也需要格外注意安全性。

雖然沒有專門的手機 App,但透過網頁瀏覽器,您依然可以在手機上享受到 Open WebUI 的便利。

總結來說,Open WebUI 是一個強大且靈活的開源工具,它降低了與先進 AI 模型互動的門檻,讓每個人都有機會打造出一個符合自己需求的個人化 AI 助理。無論您是技術愛好者,還是希望提升工作效率的職場人士,或是單純對 AI 充滿好奇的使用者,Open WebUI 都值得您深入探索和嘗試。