如何處理離群值:掌握數據精準分析的關鍵策略與實戰指南

欸,你是不是也遇過這種情況?好不容易蒐集了一大堆珍貴的數據,正準備摩拳擦掌好好分析一番,卻發現裡面夾雜著一些「怪咖」,那些數值異常地高或低,跟其他資料格格不入。這些「怪咖」就是我們常說的「離群值」(Outliers)啦!它們的存在,往往讓我們的數據分析結果變得不準確,模型表現也大打折扣,搞得頭很痛,對不對?

那麼,到底該怎麼處理離群值呢? 其實啊,處理離群值並沒有一個放諸四海皆準的「萬靈丹」,它更像是一門藝術,需要結合你的數據特性、分析目的和領域知識來做判斷。不過別擔心,核心原則通常是先「偵測」它們的存在,然後根據其性質和潛在影響,決定是「保留」、「轉換」、「移除」還是「替代」。最重要的是,千萬不要盲目地移除任何離群值喔!因為有時候,這些看起來格格不入的數據,反而是最寶貴的資訊來源呢!接下來,我會帶你一步步深入了解如何優雅又專業地「處理離群值」,讓你的數據分析更上一層樓。

Table of Contents

為什麼離群值會讓人這麼「頭大」?深入理解其影響力

在我們深入探討如何處理離群值之前,先來搞清楚,這些「不速之客」究竟會帶來哪些麻煩,好讓我們知道為什麼要這麼重視它。說真的,離群值對數據分析的影響是全面性的,不論是統計描述、模型建立,甚至是最終的商業決策,都可能因為它而產生偏差。想像一下,你正在用一群人的平均收入來評估一個地區的消費力,結果裡面突然冒出一個超級富豪,他的收入遠遠超過其他人。這時候,如果把他的收入也納入計算,整個平均值就會被大幅拉高,導致你誤以為這個地區的消費力超強,但實際上,大部分居民可能根本沒有那麼高的收入。這就是離群值造成的「誤導」。

- 扭曲統計指標: 離群值最直接的影響就是會扭曲各種統計量。像是平均數(Mean)對離群值就非常敏感,一個極端值就能讓它偏離常態;但中位數(Median)和眾數(Mode)則相對穩定。標準差(Standard Deviation)也會因為離群值而變大,使得數據的變異性被高估。

- 影響模型效能: 很多機器學習模型對離群值是相當敏感的。例如,線性迴歸模型會努力去擬合所有數據點,包括離群值,這可能導致迴歸線被拉偏,模型的預測能力就會大大下降。決策樹和隨機森林等基於樹的模型相對來說雖然比較魯棒,但極端離群值仍然可能在樹的構建過程中產生不必要的分割。

- 誤導決策: 如果你依賴有離群值的分析結果來做商業決策,那可就麻煩了。例如,在詐欺偵測中,真正的詐欺行為本身就是一種離群值,如果你把它當成「噪音」移除,那就錯失了偵測的目標。又比如,在製造業中,產品良率的異常下降,可能就是離群值在告訴你,生產線上出現了嚴重的問題,需要立即處理。

- 降低數據視覺化效果: 當數據中存在極端離群值時,在繪製圖表(如散佈圖、直方圖)時,為了包含這些極端點,圖表的比例尺會被拉得很開,導致大部分數據點擠在一起,難以觀察它們的真實分佈和模式。

所以你看,處理離群值真的不是一件小事,它是數據清洗和預處理階段中,一個既關鍵又充滿挑戰性的環節。正確地處理離群值,是我們確保數據分析結果可靠性、提升模型預測能力、進而做出明智決策的必經之路。

離群值百百種:先搞清楚你的「敵人」是什麼類型

處理離群值,就像打仗一樣,要先知己知彼嘛!不是所有的離群值都長一樣,它們根據不同的情境和特性,可以分成好幾種。了解這些類型,能幫助我們更精準地選擇處理策略喔!

單變量離群值 (Univariate Outliers)

這是最常見也最容易理解的一種。顧名思義,它指的是在單一變數(或稱特徵)中,數值顯著偏離大部分數據的點。

舉例來說: 如果你測量一群成年人的身高,大部分都在160-185公分之間,結果出現一個250公分的身高,那這就是一個單變量離群值(當然,這個數據很有可能是輸入錯誤啦,哈哈)。

多變量離群值 (Multivariate Outliers)

這種就比較 tricky 了!它指的是在多個變數的組合中,顯得異常的數據點。單獨看每個變數,它可能都還在正常範圍內,但當這些變數組合起來時,卻顯得不協調。

舉例來說: 假設我們有「年齡」和「銀行存款」兩個變數。一個25歲、存款5萬塊的人,或是一個60歲、存款100萬的人,單獨看都挺正常的。但如果出現一個25歲卻有5億存款的人,這個組合就非常離奇了。雖然單獨看25歲和5億存款都不是絕對的離群值,但放在一起就成了多變量離群值。這種情況需要更進階的分析方法才能偵測出來喔。

情境離群值 / 環境離群值 (Contextual Outliers)

這種離群值非常有意思,它必須依賴特定的「情境」才能判斷其異常性。同樣的數值,在不同的情境下,意義可能完全不同。

舉例來說: 一筆信用卡交易金額是10000元。如果在一般消費情況下,這可能不算什麼。但如果這筆交易發生在凌晨三點、地點卻是遙遠的國家,而且是這張卡平常從來沒有過的消費模式,那麼這筆10000元的交易就成了情境離群值。它不是單純的數值極端,而是因為「時間」和「地點」等情境因素,才顯得異常。

集體離群值 (Collective Outliers)

集體離群值指的是一組數據點,雖然每個點單獨來看可能不夠異常,但它們作為一個集合出現時,卻顯得與整個數據集的模式不符。

舉例來說: 想像一個網站的流量數據。在大部分時間裡,流量都是起起伏伏的,但突然有連續幾個小時,流量都維持在一個異常的高點或低點,雖然每個小時的流量單獨看可能不算「破紀錄」,但這連續幾個小時的「模式」就構成了一個集體離群值。這可能意味著網站遭到了攻擊,或是某個行銷活動異常成功,非常值得探究。

了解這些離群值的類型,是不是覺得處理起來更有方向了呢?因為不同類型的離群值,可能需要不同的偵測技術和處理策略。所以,在動手處理之前,先花點時間觀察你的數據,試圖判斷它們屬於哪一種類型,這會讓你的工作事半功倍喔!

揪出「怪咖」:離群值偵測的實戰招數大公開

好啦,既然知道離群值這麼麻煩,而且還有這麼多種「變身」,那第一步當然是要把它們給揪出來啊!這就像是警方辦案,你得先知道嫌疑犯是誰嘛!離群值偵測的方法可多了,從簡單的統計圖表,到複雜的機器學習演算法,都可以派上用場。我這邊就列出一些最常用也最實用的方法給你們參考喔!

視覺化偵測法:一眼看出不對勁!

這是最直觀也最基礎的方法,很多時候,一張圖表就能幫你找出端倪。我個人在做數據分析的時候,一定會先從視覺化開始,因為它能提供很多直覺上的線索。

- 盒形圖 (Box Plot): 喔,這個超好用!盒形圖能清楚地展示數據的四分位數、中位數和極值。通常,在箱子(Interquartile Range, IQR)外面,超過1.5倍IQR範圍的點,就會被標示為潛在的離群值。這對於單變量離群值的偵測非常有效。

我的經驗談: 每次拿到新數據,我一定先畫盒形圖。很多時候,根本不用跑什麼複雜演算法,光看盒形圖,就能初步判斷數據有沒有明顯的離群值,而且還能順便檢查數據的分佈偏不偏。 - 散佈圖 (Scatter Plot): 對於雙變量或多變量數據,散佈圖能幫助我們觀察變數之間的關係。如果數據點明顯遠離主要的點群,那它很可能就是多變量離群值。

我的經驗談: 我曾經在分析客戶消費行為時,發現散佈圖上有幾個點,客戶年齡和消費金額的組合非常奇特,明顯跟其他客戶的消費模式不同。一深入調查,才發現那是幾個詐欺交易的記錄,幸好有散佈圖的幫忙! - 直方圖 (Histogram): 也能大致看出數據的分佈,如果直方圖的尾部出現一些非常稀疏但值卻很高的柱狀,那可能暗示著有離群值存在。

統計學偵測法:用數字說話!

當視覺化覺得不夠精確時,統計學的方法就派上用場了。它們透過計算數據點與中心趨勢的距離,來量化其「異常程度」。

- Z-Score (標準分數):

- 原理: 衡量一個數據點偏離平均值有多少個標準差。

- 計算方式: `Z = (x – μ) / σ`,其中 `x` 是數據點,`μ` 是平均值,`σ` 是標準差。

- 判斷標準: 通常,如果 `|Z| > 2` 或 `|Z| > 3`(依據數據量和領域知識調整),就被視為離群值。

- 優點: 簡單好理解,容易計算。

- 缺點: 對於偏態分佈的數據效果不佳,且平均值和標準差本身會被離群值拉偏,可能導致「遮蔽效應」(Masking Effect),即真正的離群值被「隱藏」起來。

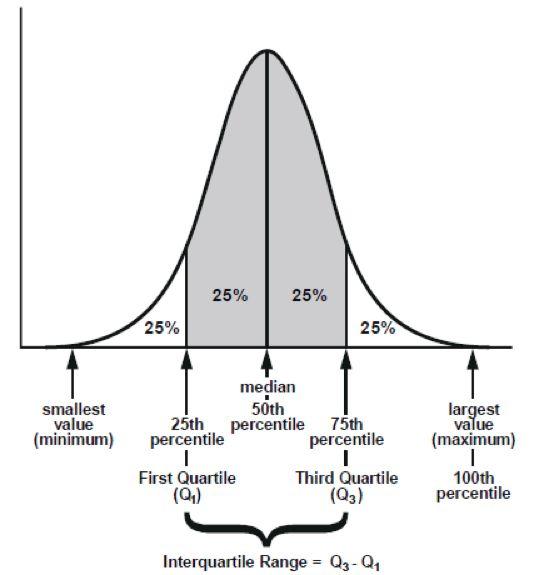

- IQR (四分位距) 法:

- 原理: 基於數據的四分位數,對離群值不敏感,因此在處理偏態數據時比Z-Score更穩健。

- 計算方式:

- 首先計算第一四分位數 (Q1) 和第三四分位數 (Q3)。

- 計算 IQR = Q3 – Q1。

- 定義上限:`Q3 + 1.5 * IQR`

- 定義下限:`Q1 – 1.5 * IQR`

- 判斷標準: 任何超出上下限的數據點都被視為離群值。

- 優點: 對於非正態分佈的數據也適用,不易受極端值影響。

- 缺點: 只適用於單變量數據,而且 `1.5` 這個閾值在某些情況下可能需要調整。

- DBSCAN (Density-Based Spatial Clustering of Applications with Noise):

- 原理: 這是一種基於密度的聚類演算法。它將密度高、連接緊密的數據點歸為一類,而那些落在低密度區域的點則被視為噪音或離群值。

- 優點: 能夠發現任意形狀的聚類,且不需要預先指定聚類的數量,非常適合偵測多變量離群值。

- 缺點: 參數(`eps` 和 `min_samples`)的選擇對結果影響很大,而且對於密度差異較大的數據集表現不佳。

- Isolation Forest (孤立森林):

- 原理: 這是一種基於樹的機器學習演算法,它利用「孤立」的思想來識別離群值。離群值因為其稀有性和獨特性,通常只需要經過較少的隨機分割就能被孤立出來。

- 優點: 對於高維數據表現良好,計算效率高,且不需要像其他方法那樣去計算距離或密度。

- 缺點: 對於某些非線性或聚集性不強的離群值可能效果一般。

- One-Class SVM (單類支持向量機):

- 原理: 這種方法試圖找到一個決策邊界,將大部分「正常」數據點包圍起來,而落在這個邊界之外的點則被視為離群值。

- 優點: 在高維空間中表現良好,能處理複雜的非線性關係。

- 缺點: 參數調整相對複雜,計算成本較高,對數據的規模敏感。

- Local Outlier Factor (LOF):

- 原理: LOF 衡量一個數據點相對於其鄰居的局部密度偏差。如果一個點的局部密度明顯低於其鄰居,那麼它就被認為是離群值。

- 優點: 能夠偵測到不同密度區域中的離群值,對於不同分佈的數據都能有不錯的效果。

- 缺點: 對於大規模數據集計算成本較高,且對參數(鄰居數量 `k`)敏感。

欸,說到這裡,你可能會覺得有點複雜,這麼多方法到底要選哪一個啊?別急,我的建議是,先從最簡單的視覺化和 IQR 法開始,快速對數據有個初步了解。如果數據比較複雜,再考慮 Z-Score (如果是正態分佈) 或是更進階的機器學習演算法。沒有哪種方法是完美的,通常會是多種方法交叉使用,才能更全面地揪出那些「怪咖」喔!

處理離群值的「兵法」:四種策略,因地制宜!

當你成功揪出了那些「怪咖」之後,接下來就是決定怎麼處理它們了。這一步可不能草率啊!錯誤的處理方式,有時候比不處理還糟糕呢。我這裡整理了四種主要的處理策略,每種都有它的適用情境、優缺點,你聽我好好解釋喔。

策略一:保留離群值 (Retaining Outliers) — 珍貴的訊號,別亂刪!

欸,你是不是覺得離群值就該全部處理掉?大錯特錯!有時候,離群值本身就是最有價值的資訊。尤其是當它們是真實的數據、並且對你的分析目的有重要意義時,你非但不能刪,反而要好好研究它們!

- 適用情境:

- 真實事件記錄: 像是金融詐欺、設備故障、病毒爆發等,這些事件本身就是極端的,但卻是我們最想偵測的目標。

- 重要趨勢或發現: 科學實驗中,一個異常的測量結果,搞不好就是一個重大突破的開端。

- 數據本身就是稀疏或極端: 如果你的數據分佈本來就不是集中在中間,而是有很多極端值,那這些極端值可能就不是離群值,而是數據的正常一部分。

- 優點: 完整保留數據的原始資訊,不會引入任何偏差。

- 缺點: 如果離群值真的是錯誤,會嚴重影響分析結果。對某些模型來說,性能會大大下降。

- 我的建議: 當你保留離群值時,可能需要使用對離群值不敏感的統計方法或模型。例如,使用中位數代替平均數,或是選擇樹模型(如決策樹、隨機森林)而不是線性模型。同時,在報告分析結果時,一定要特別說明這些離群值的存在和它們可能帶來的影響,以增加透明度。

策略二:轉換離群值 (Transforming Outliers) — 讓數據「溫馴」一點

有時候,離群值只是因為數據本身的尺度太大,或是分佈極度偏態才顯得異常。這時候,我們可以用數據轉換的方式,來縮小它們的「破壞力」,讓數據分佈更接近常態,模型處理起來也會更舒服。

- 常用方法:

- 對數轉換 (Log Transformation): 這是最常用的一種,特別適合處理右偏的數據(也就是有很多小值,但少數極大值的數據)。`log(x)` 或 `ln(x)` 可以大幅縮小極大值與其他值的差距。

- 平方根轉換 (Square Root Transformation): `sqrt(x)`,效果比對數轉換溫和一點,也適用於右偏數據。

- Box-Cox 轉換: 這是一種更通用的轉換方法,它可以根據數據自動選擇最適合的轉換方式(包括對數和平方根)。

- 優點:

- 保留了數據的相對關係,沒有丟失資訊。

- 可以改善數據的常態性,讓更多統計方法和模型適用。

- 減少離群值對模型建立的影響。

- 缺點:

- 轉換後的數據解釋起來會比較不直觀。

- 並非所有數據都適合轉換,過度轉換可能扭曲數據的真實意義。

- 我的經驗談: 我在處理薪資或房價這類數據時,通常會考慮對數轉換。因為這類數據通常呈現嚴重右偏,有少數超高薪資或超高房價的離群值。轉換後,模型對這些極端值的敏感度會降低,預測結果也會更穩定。但轉換前一定要確認數據有沒有零或負值喔,因為對數函數在這些情況下是沒有定義的。

策略三:移除離群值 (Removing Outliers) — 斬草除根,但要小心!

這是最直接,也是最簡單粗暴的方法。如果確定離群值是錯誤的數據(例如,數據輸入錯誤、測量儀器故障),或者是對你的分析目的沒有任何意義的「噪音」,那麼移除它們確實是個好選擇。但,你聽我說,這是「萬不得已」才用的招數!

- 適用情境:

- 數據輸入錯誤: 例如身高欄位出現 2500 公分,明顯是多打了一個零。

- 測量錯誤: 感測器故障導致的異常讀數。

- 數據採集過程中的異常: 例如問卷作答者隨意填寫的極端值。

- 離群值數量極少且確認無意義: 如果離群值只佔整個數據集的極小部分(例如小於1%),且確定它們是噪音,移除的風險較低。

- 優點:

- 簡化數據集,讓分析和模型訓練變得更容易。

- 可以顯著提高某些模型的性能和準確性。

- 缺點:

- 可能丟失重要資訊: 如果你移除的是真實且有意義的離群值,那就後悔莫及了。

- 降低數據集的代表性: 如果移除太多離群值,可能會改變數據的原始分佈,導致分析結果無法代表真實情況。

- 減少數據量: 對於本身數據量就不大的數據集來說,移除離群值可能會進一步縮減樣本數,影響統計推斷的穩定性。

- 實踐方式:

- 刪除整列: 如果整個變數都是垃圾數據,或離群值佔比極高。

- 刪除特定行: 針對偵測到的離群值所在的那一行數據進行刪除。

- 截斷 (Trimming / Truncation): 設定一個上下限,所有超出這個範圍的數據點都直接刪除。

- 我的忠告: 在決定移除離群值之前,一定要再三確認它的性質和來源。我會建議,在移除之後,最好再重新評估一次數據分佈和模型表現,看看效果是不是真的變好了。如果不是特別有把握,盡量避免直接移除。

策略四:替代離群值 (Imputing Outliers) — 「填補」讓數據更完整

這種方法是將離群值用某個「合理」的值來替代,而不是直接移除。它的目標是盡量保留數據點,但又消除離群值的極端影響。這其實有點像處理缺失值的方法。

- 常用方法:

- Winsorization (溫莎化): 這是一種常見的替代方法。它不是刪除離群值,而是將極端值「限制」在一個特定的閾值範圍內。例如,將所有高於第99百分位數的值替換為第99百分位數的值,將所有低於第1百分位數的值替換為第1百分位數的值。這就像是把特別高的山峰削平一點,把特別深的谷地填高一點,但保留了山谷的存在。

- 使用中位數 / 平均數 / 眾數替代: 這比較像是缺失值處理的翻版。如果離群值被認為是錯誤,可以用該變數的中位數(對離群值不敏感)或平均數(如果數據分佈較為正常)來替代。但這可能會引入新的偏差,因為你等於是創造了新的數據點。

- 基於模型的替代 (Model-based Imputation): 這種方法更為進階。你可以利用其他相關變數,建立一個模型(例如迴歸模型),來預測這些離群值應該是什麼樣子,然後用預測值來替代。這比簡單的平均數替代要來得精準,但計算量也更大。

- 優點:

- 不會丟失任何數據點,保留了數據的完整性。

- 減少了離群值對模型訓練的負面影響。

- 缺點:

- 「人為」創造了數據點,可能引入新的偏差。

- 替代值的選擇會影響分析結果,需要謹慎。

- 我的經驗談: 在我處理問卷數據時,如果遇到少數極端答案(例如1-10分,有人填了100分),我通常會用Winsorization。將100分限制在10分,這樣既保留了這個人的數據,又糾正了明顯的錯誤,減少了它對平均分值的巨大影響。

總之,選擇哪種策略,最重要的還是要回歸你的分析目標和對數據的理解。沒有最好的方法,只有最適合你當下情境的方法。多嘗試,多比較,你就會找到最優解喔!

「處理離群值」的黃金原則:我的獨家心法分享

處理離群值,說真的,不能只靠演算法和公式,更需要一種「直覺」和「判斷」。經過這麼多年跟數據打交道,我累積了一些獨家的「黃金原則」,想分享給你,希望對你有幫助!

原則一:先別急著動手,理解是第一步!

這是最最重要的一點!很多新手看到離群值就想趕快刪掉,覺得它們很礙眼。但我會建議,在任何處理之前,先停下來,好好「審問」這些離群值:

- 它們是怎麼來的? 是數據輸入錯誤?測量儀器故障?還是真實存在的罕見事件?

- 它們代表什麼? 是詐欺?是產品瑕疵?還是市場新趨勢?

- 它們對你的分析目標有什麼影響? 如果它們對你的模型或結論有重大影響,那更要仔細研究。

就像前面提到的信用卡詐欺案例,如果直接移除這些「看起來異常」的交易,那你的詐欺偵測模型可能就永遠學不到如何辨識詐欺了!

原則二:領域知識 (Domain Knowledge) 是你的「超級武器」!

再厲害的演算法,都比不上你對數據所屬領域的理解。當你對數據來源、生成過程和業務背景有深入了解時,你就能更好地判斷一個離群值究竟是「錯誤」還是「訊號」。

我記得有一次,我們在分析某個電商網站的客戶消費金額。數據中突然出現一筆高達數百萬元的交易,遠超其他所有訂單。如果單純用統計方法,這絕對是個超級離群值。但後來我們諮詢了業務部門,才發現那是一位VIP客戶訂購了一批高價限量款商品,而且是真實有效的交易。如果當時我們盲目刪除,就可能錯失了這位超級VIP的購買力分析。

所以,別光顧著埋頭寫程式,多跟業務方溝通,多了解數據背後的故事,這絕對會讓你事半功倍。

原則三:測試!測試!再測試!

不管你選擇哪種處理方式,都不能拍腦袋決定。最好的方法是 A/B Testing:

- 不處理離群值,訓練一個模型。

- 用某種方法處理離群值後,再訓練一個模型。

- 比較這兩個模型的表現,看看哪個效果更好。

你可以評估模型的準確度、召回率、F1-Score 等指標,看看處理離群值後是否真的有提升。如果處理後模型表現反而下降,那就要重新審視你的處理策略了。

原則四:透明化和紀錄的重要性

當你對數據做了任何處理,包括離群值處理,一定要詳細記錄下來。包括:

- 你偵測到哪些離群值。

- 你選擇了什麼處理方法。

- 為什麼選擇這個方法(理由是什麼)。

- 處理後數據發生了什麼變化。

這樣不僅能讓你的工作更有條理,也能方便日後回溯檢查,甚至是團隊協作時,其他人也能清楚了解數據的處理歷程。尤其是在資料科學專案中,數據的「血統」和「變革史」是非常重要的。

原則五:有時候,離群值就是一個「新的變數」!

這是一個比較進階的思考方式。當離群值是真實且重要的「訊號」時,你甚至可以考慮為它創建一個新的二元變數(Flag variable)。例如,如果偵測到的是一個「高度異常交易」,你可以創建一個新的變數 `is_fraud`,將該筆交易標記為 `1`,其他為 `0`。這樣一來,你的模型就可以學習「是否為異常」這個特徵,而不會因為它的極端數值而受到影響。

總之,處理離群值就像是醫生看病,沒有一套流程可以套用在所有病人身上。你必須先診斷,再下藥,而且還要隨時觀察病人的反應。多思考、多嘗試、多溝通,你一定能成為處理離群值的高手!

常見問題與專業解答:關於離群值,你可能還想知道的事

離群值會對機器學習模型造成什麼影響?

離群值對機器學習模型的影響其實非常深遠,而且因模型而異。但總體來說,它們經常會導致模型的「過擬合」(Overfitting)或「欠擬合」(Underfitting),進而降低模型的泛化能力和預測準確性。

對於基於距離或梯度的模型,例如線性迴歸、邏輯迴歸、K-Means 聚類、支持向量機(SVM),離群值的影響尤其顯著。這些模型在訓練過程中,會嘗試最小化誤差或最大化邊界。一個或幾個極端離群值,可能會使得模型為了適應這些異常點而大幅調整其參數,導致模型的決策邊界或迴歸線被拉向這些離群值,從而犧牲了對大部分「正常」數據點的擬合優度。結果就是,模型在訓練集上可能表現不錯,但在未見過的測試數據上,表現就會很差,這就是典型的過擬合。

相反地,對於基於樹的模型,例如決策樹、隨機森林、梯度提升樹(如 XGBoost、LightGBM),它們對離群值的敏感度相對較低。這是因為樹模型通常採用基於規則的分裂方式,它們會優先找到最能區分數據的特徵閾值。一個極端值通常只會影響其所在分支的路徑,而不會像線性模型那樣「拖累」整個模型的參數。然而,如果離群值的數量足夠多,或者它們在特徵空間中形成了某種「模式」,仍然可能導致樹模型在學習過程中產生不必要的複雜度或誤判。

此外,離群值還可能影響模型的穩定性。例如,在特徵工程階段,如果離群值導致某些特徵的方差異常大,那麼基於方差選擇特徵的方法可能會受到誤導。在模型評估階段,像均方誤差(MSE)這類對極端值敏感的指標,也可能會因為離群值而產生偏差,使得我們對模型性能的判斷不準確。

什麼時候不應該移除離群值?

這是一個非常關鍵的問題,也是我前面一直強調的「黃金原則」之一!千萬不要盲目移除離群值,否則你可能會丟失寶貴的資訊。

首先,當離群值是真實且有意義的數據點時,你就不應該移除它們。這類離群值通常代表著罕見但重要的事件、現象或特徵。例如,在醫學研究中,一個病人對某種藥物產生了極端不良反應,這就是一個離群值,但它卻可能揭示藥物的潛在風險;在金融交易中,一筆異常大額的轉帳,可能是高淨值客戶的正常行為,也可能是詐欺的早期訊號。如果將這些真實的、有價值的離群值移除,你將會失去從中學習的機會,甚至可能導致錯誤的決策或錯失重要的商業洞察。

其次,當離群值數量較多,且其分佈並非「意外」,而是數據本身特性的一部分時,也不宜移除。有些數據集天生就具有長尾分佈或極端值較多的特性,例如個人財富分佈、網絡流量模式、地震強度等。在這些情況下,這些「離群值」並非錯誤或噪音,而是真實反映了數據的固有結構。盲目移除反而會扭曲數據的原始分佈,使得分析結果無法代表真實世界的情況。

再來,如果你的分析目標就是為了偵測或研究這些異常行為,那更不應該移除它們。例如,故障偵測、入侵偵測、醫療異常診斷等,這些問題的核心就在於識別那些「不一樣」的數據點。此時,離群值不僅不應被移除,反而應該成為你模型訓練的重點目標。

最後,如果你的數據集本身數據量不大,移除任何數據點都可能導致樣本量不足,進而影響模型的穩定性和統計推斷的可靠性。在這種情況下,通常會優先考慮數據轉換或替代等保留數據點的方法。

如何判斷離群值是「真的」還是「錯的」?

判斷離群值是「真的」(有意義)還是「錯的」(錯誤),這確實是處理離群值過程中最具挑戰性,也最需要經驗的一環。這沒有一個標準化的公式,但你可以遵循一套系統性的思考流程:

第一步:數據源頭追溯與驗證

- 檢查數據採集過程: 詢問負責採集數據的人員,是否有任何異常事件發生?例如,傳感器故障、人工輸入錯誤、數據轉換錯誤等。

- 原始記錄核對: 如果有可能,嘗試回溯到原始記錄(例如紙本紀錄、資料庫日誌),核對該離群值是否與原始記錄一致。這在金融交易或客戶資料中尤其重要。

- 數據輸入規範: 檢查數據輸入時是否有設定範圍或限制。例如,身高欄位如果設定了最大值為200公分,那麼出現250公分就是輸入錯誤。

第二步:運用領域知識與專家諮詢

- 諮詢領域專家: 這是最有效的方法之一。把這些離群值呈現給對該領域有深入了解的專家看,他們通常能憑藉經驗判斷這些值是否合理,或者背後可能的原因。例如,金融分析師可以判斷一筆大額交易是否符合客戶的歷史行為模式。

- 比較行業基準或常識: 將離群值與行業的平均水平、常識性範圍進行比較。一個人的月收入幾百萬台幣可能是真的,但幾億台幣如果沒有特別的背景說明,那可能就是錯的。

第三步:數據視覺化深入分析

- 多維度視覺化: 不要只看單一變數。將離群值與其他相關變數一起繪製散佈圖、平行座標圖等,觀察它在多維度空間中的位置和關係。例如,一個高消費額的客戶,如果他的年齡、職業、居住地等其他特徵都顯示為「普通」,那麼這筆高消費就更值得懷疑。

- 時間序列分析: 如果數據有時間維度,觀察離群值在時間序列上的表現。它是否是一個孤立的點?是否與某個特定事件(例如促銷活動、系統更新)相關聯?

第四步:邏輯一致性檢查

- 內部邏輯: 檢查離群值是否與數據集內的其他變數存在邏輯上的矛盾。例如,一個被診斷出患有老年癡呆的病人,如果他的年齡是5歲,這顯然是邏輯錯誤。

- 外部數據驗證: 如果有外部的、獨立的數據源可以交叉驗證,可以利用它來判斷離群值的真偽。

透過這些步驟,你會對離群值的性質有更清晰的判斷。記住,判斷過程常常是多方求證、層層深入的,不是一蹴可幾的喔!

對於不同類型的數據,處理離群值的方法有何不同?

確實,數據的類型是選擇離群值處理方法的關鍵因素之一。我們會根據數據是數值型還是類別型,以及它們的分佈特性來調整策略。

數值型數據 (Numerical Data):

這是我們最常討論的離群值場景。

- 單變量離群值: 對於單一數值變數,我們前面提到的盒形圖 (IQR)、Z-Score 都是很直觀有效的偵測方法。處理上,如果確認是錯誤值,可以考慮移除;如果是有意義但極端的,則可以考慮轉換(對數、平方根)或 Winsorization。

- 多變量離群值: 當考慮多個數值變數的組合時,視覺化方法如散佈圖仍然重要,但更需要結合機器學習方法,例如 Isolation Forest、One-Class SVM、LOF,或利用 Mahalanobis Distance 等統計量來偵測。處理上,通常會更傾向於轉換或替代,因為移除一個多變量離群值可能丟失其他變數的正常資訊。

- 時間序列數據: 在時間序列中,情境離群值和集體離群值尤為重要。一個在特定時間點出現的異常值(例如傳感器讀數瞬間飆高),或是連續一段時間的數據都呈現異常模式,都需要特別處理。偵測上可以使用移動平均線、指數平滑、或是結合序列相關性的異常偵測演算法(如 ARIMA 模型的殘差分析)。處理上,通常會考慮使用插值法(例如線性插值、樣條插值)來替代單個時間點的離群值,或是在模型中納入時間因素來解釋這些異常。

類別型數據 (Categorical Data):

類別型數據中的「離群值」概念會稍微有些不同,我們通常稱之為「異常類別」或「稀有類別」。

- 偵測: 通常是透過頻率分析。計算每個類別的出現次數或比例。如果某個類別的出現頻率極低(例如,佔總體數據的0.1%以下),且不符合業務邏輯,就可能被視為異常。例如,一個表示性別的欄位,除了「男」、「女」之外,偶爾出現「未知」或「其他」類別,如果比例極低,可能需要特別處理。

- 處理:

- 合併稀有類別: 將所有出現頻率極低的類別合併成一個新的類別,例如「其他」。這可以減少類別變數的維度,防止模型對這些稀有類別過度擬合。

- 視為缺失值: 如果稀有類別被認為是錯誤輸入,可以將其視為缺失值,然後使用類別變數的缺失值處理方法(例如用眾數填充)。

- 編碼策略: 在將類別變數轉換為數值進行模型訓練時,慎選編碼方式。例如,One-Hot Encoding 在處理稀有類別時可能會導致維度爆炸,並產生稀疏特徵,此時可以考慮 Target Encoding 或 Frequency Encoding 等方法。

- 作為異常標記: 如果稀有類別本身就是重要的異常資訊(例如「詐欺類型」),則應該保留並作為模型學習的目標。

總之,不管是哪種數據類型,了解其背後的業務含義和數據生成機制,永遠是選擇最合適處理方法的基石。

處理離群值有什麼軟體工具或函式庫推薦嗎?

當然有啊!現在數據科學這麼盛行,各種工具和函式庫都非常豐富。我主要用 Python,因為它的生態系真的很完整,所以下面推薦的也多半是 Python 的函式庫喔!

1. 數據處理與視覺化基礎工具:

- Pandas: 這是 Python 數據分析的核心函式庫,所有數據讀取、清洗、預處理都離不開它。用它來篩選數據、進行數據轉換、甚至初步偵測離群值都超級方便。

df[df['column_name'] > upper_bound]這樣的語法就能輕鬆找出極端值。 - NumPy: 數學運算的基石,提供高效的多維數組操作。很多統計計算,像是平均值、標準差、四分位數,都會用到它。

- Matplotlib / Seaborn: 這兩個是 Python 最強大的數據視覺化工具。

- Matplotlib: 靈活度高,幾乎可以畫出任何你想要的圖。用它來畫直方圖、散佈圖、折線圖都是基礎。

- Seaborn: 基於 Matplotlib,提供了更美觀的預設樣式和更多統計圖表,特別適合用來畫盒形圖(

sns.boxplot())、小提琴圖(sns.violinplot())、多變量散佈圖(sns.pairplot()),偵測離群值非常直觀。

2. 離群值偵測專用函式庫:

- Scikit-learn (sklearn): 這個函式庫是機器學習的瑞士刀,裡面包含了許多離群值偵測演算法,方便你直接調用。

sklearn.ensemble.IsolationForest: 孤立森林,對於高維數據的離群值偵測效果很好,而且速度快。sklearn.svm.OneClassSVM: 單類支持向量機,適合偵測複雜分佈中的異常值。sklearn.neighbors.LocalOutlierFactor(LOF): 局部離群因子,能有效偵測局部密度的異常點。sklearn.covariance.EllipticEnvelope: 假設數據服從高斯分佈,通過擬合一個橢圓形邊界來偵測離群值。

- PyOD (Python Outlier Detection): 這是專門為離群值偵測設計的函式庫,涵蓋了超過30種不同的偵測演算法,比 Scikit-learn 更全面,功能也更強大。如果你需要嘗試多種算法來比較效果,PyOD 會是你的首選。它包含了基於統計、聚類、距離、密度、集成等各種方法的離群值偵測器。

3. 數據轉換與標準化工具:

- Scikit-learn (

sklearn.preprocessing):StandardScaler/MinMaxScaler: 數據標準化/歸一化,雖然不是直接處理離群值,但可以減少離群值對距離類模型(如 K-Means)的影響。PowerTransformer(包括 Box-Cox 和 Yeo-Johnson): 用於數據轉換,可以讓數據分佈更接近常態,從而間接處理了離群值導致的偏態問題。

我的個人工作流程建議:

我通常會這樣操作:

- 初步探索: 使用 Pandas 讀取數據,然後用 Seaborn 繪製盒形圖、直方圖、散佈圖,快速找出明顯的單變量離群值和多變量離群值。

- 統計學驗證: 對於視覺化觀察到的離群值,會用 NumPy 或 Pandas 計算 IQR 上下限來確認。

- 進階偵測: 如果數據複雜或高維,就會引入 Scikit-learn 的 Isolation Forest 或 PyOD 函式庫,來跑更精密的離群值偵測。

- 處理決策: 根據前面判斷離群值真偽的原則,決定是保留、轉換、移除還是替代。如果需要轉換,就用 Scikit-learn 的

PowerTransformer;如果需要 Winsorization,可以自己寫一個簡單的 Pandas 函數或利用一些專門的統計函式庫(如 SciPy 也有一些統計功能)。 - 結果評估: 處理完後,再次視覺化數據分佈,並重新訓練模型,比較處理前後的模型性能指標,確保我的處理是有效的,而且沒有引入新的問題。

這些工具搭配使用,會讓你在處理離群值時,事半功倍,而且結果也會更可靠喔!