Google 試算表 最多幾列:從限制到高效數據管理的深度解析

最近,小陳在處理一份客戶資料,檔案越來越大,他心裡不禁犯嘀咕:「欸,Google 試算表到底可以裝多少資料啊?會不會有一天就爆掉了啊?」這個問題,相信許多經常使用 Google 試算表的朋友都曾經想過,尤其當手上的資料量越來越龐大時,這個疑問就會變得更加實際而迫切。

那麼,Google 試算表 最多幾列呢?答案是:目前 Google 試算表的列數上限是 1000 萬列(10,000,000 列)。這個數字對於絕大多數的日常使用來說,已經是個非常寬裕的空間了。不過,光知道這個數字還不夠,更重要的是了解這個限制背後的原因、它如何影響我們的使用體驗,以及當我們真的需要處理這麼大量資料時,有哪些眉角和技巧可以幫助我們更有效率地管理。

Table of Contents

Google 試算表列數的演進與現況:千萬列的里程碑

說到 Google 試算表的列數限制,其實它並不是一成不變的喔!過去幾年,Google 一直在逐步提升這個上限,以應對使用者日益增長的資料處理需求。這是一個不斷優化的過程,也反映了雲端技術的進步。

- 早期的限制: 剛開始,Google 試算表的限制是「200 萬個儲存格」。是的,你沒聽錯,是儲存格!這意味著如果你只有很少的欄位,或許可以擁有較多的列;但如果欄位一多,列數很快就會被壓縮。

- 第一次重大提升: 隨後,這個限制被提升到「500 萬個儲存格」。這已經是一個很大的進步了,讓許多中小企業能夠更自在地使用 Google 試算表。

- 邁向「列」的限制: 接著,Google 將限制從單純的儲存格數量,轉變為同時考量儲存格和列數。有一段時間,雖然儲存格總數有所限制,但列數也明確地給出了一個更高的上限,大約在 200 萬列左右。

- 目前的千萬列: 而現在,我們迎來了這個振奮人心的數字:1000 萬列!這是一個非常明確且龐大的限制,讓使用者在規劃大型專案時,能有更多的彈性與信心。這背後是 Google 強大的雲端基礎設施和優化技術在支撐,真的很厲害欸!

這次的提升不只是數字上的變化,更代表著 Google 對於試算表作為一個強大資料處理工具的定位。它不再只是單純的文書處理軟體,而是能夠承載更多商業邏輯和資料分析任務的平台。

我的觀察: 從儲存格數量到明確的列數限制,這反映了 Google 試算表的使用情境越來越偏向於「資料庫」的應用。當我們談論數百萬筆的交易紀錄、客戶清單或感測器資料時,以「列」為單位來衡量容量,會比「儲存格」來得更直觀、更符合實際需求。這也讓使用者能更清楚地知道,他們的資料到底能「塞」多少進去。

深入剖析:為什麼會有列數限制?效能與穩定性的平衡點

你可能會問,既然 Google 的伺服器那麼厲害,為什麼不乾脆無限多列就好呢?其實,任何系統都有其限制,這背後牽涉到複雜的技術考量,主要是為了在「提供巨大容量」和「維持系統效能與穩定性」之間找到一個最佳的平衡點。

- 雲端基礎設施的負載: 儘管 Google 擁有龐大的資料中心,但每個試算表實質上都運行在他們的伺服器上。當一個試算表變得極其龐大時,伺服器需要更多的記憶體、CPU 來載入、計算和儲存這些資料。想像一下,全球數十億個試算表,如果每個都無限大,那對伺服器的壓力將會是天文數字,很容易造成系統延遲甚至崩潰。

- 瀏覽器與客戶端渲染: Google 試算表是在瀏覽器中運行的。當你打開一個超級大的試算表時,你的瀏覽器需要下載這些資料,並將其渲染(呈現)在螢幕上。數百萬列的資料,即使只是顯示一部分,也需要消耗大量的記憶體和處理器資源。你的電腦或手機可能就會變得很卡頓,甚至當機,這絕對不是我們希望看到的用戶體驗,對吧?

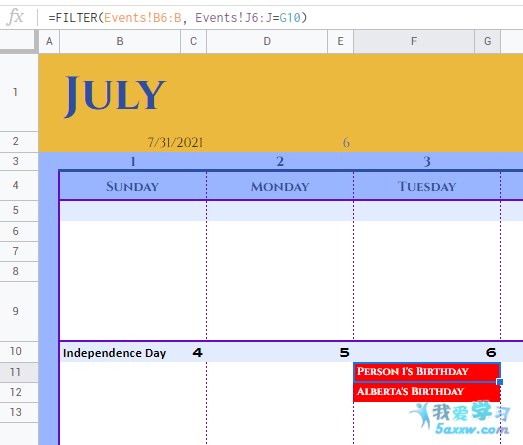

- 公式與腳本的計算複雜度: 試算表不只是儲存資料,它還有各式各樣的公式、篩選器、樞紐分析表,甚至是用 Google Apps Script 編寫的自訂腳本。這些功能在處理小量資料時可能輕而易舉,但一旦資料量達到百萬級別,每次更動、每次重新計算,都可能耗費大量的運算時間,嚴重影響工作效率。

- 資料一致性與備份: 確保巨量資料的一致性、即時儲存和可靠備份,也是一個巨大的挑戰。Google 需要確保無論何時,你的資料都是最新的、沒有損壞的,並且可以在任何時候被恢復。資料量越大,管理和維護的複雜度就越高。

- 協作的流暢性: Google 試算表的一大優勢就是多人協作。如果檔案過大,多人同時編輯就更容易產生衝突,或者導致同步延遲,影響協作效率。畢竟,沒有人喜歡看著游標在那裡轉圈圈,等半天資料才更新吧?

所以,這個 1000 萬列的限制,其實是 Google 綜合考量了各種技術因素、用戶體驗以及系統穩定性後,所設定的一個「甜蜜點」。它在提供足夠容量的同時,也盡力保證了大多數情況下的流暢體驗。

當資料量逼近極限時:Google 試算表效能會發生什麼事?

即使有了 1000 萬列的超大容量,當你的資料量真的非常接近這個數字時,你可能會開始感受到一些效能上的「不適」。這就像一台車,雖然極限時速很高,但開到極限速度,油耗和引擎磨損也會大大增加。以下是一些常見的效能問題:

- 載入緩慢: 開啟試算表的時間會顯著拉長。你可能需要等待數十秒,甚至一兩分鐘,才能看到所有內容載入完畢。

- 公式計算延遲: 只要修改一個儲存格,或新增一列資料,試算表中的所有相關公式都可能需要重新計算。當公式複雜且資料量龐大時,這個計算過程會非常漫長,你會看到畫面底部顯示「正在計算」的字樣,然後卡頓好一陣子。尤其是那些使用

IMPORTRANGE、QUERY等函數的跨表引用,延遲會更明顯。 - 篩選、排序卡頓: 想要對數百萬列資料進行篩選或排序?這可是一項大工程!試算表會需要時間來處理這些指令,等待的時間會明顯增加。

- 協作體驗下降: 多人同時編輯時,延遲感會更嚴重。你輸入的內容可能不會立即顯示給協作者,或者協作者的修改要等一陣子你才能看到,大大降低了協作的流暢度。

- Apps Script 執行超時: 如果你寫了 Google Apps Script 來自動化處理資料,在處理巨量資料時,這些腳本很容易因為執行時間過長而超時,導致任務失敗。

- 瀏覽器記憶體佔用高: 你的瀏覽器分頁可能會吃掉大量的記憶體,導致電腦整體運行變慢,甚至其他程式也會受到影響。

這些情況的發生,其實都在提醒我們,Google 試算表雖然功能強大,但它畢竟是一個「線上試算表」,並不是專門為巨量資料分析設計的資料庫系統。了解這些效能瓶頸,有助於我們在面對大數據時,做出更明智的工具選擇和資料管理策略。

超越限制:面對巨量資料的實用策略與管理技巧

既然我們知道了 Google 試算表有其效能上的極限,那麼當我們的資料量真的很大、或是可能超過 1000 萬列的時候,該怎麼辦呢?別擔心,其實有很多聰明的方法可以幫助我們管理和處理巨量資料,讓工作不至於被卡住!

1. 資料分拆與結構化:化整為零的智慧

這是我個人覺得最實用也最容易上手的技巧之一。與其把所有雞蛋都放在同一個籃子裡,不如把它們分開存放,但又保持彼此的關聯性。

- 建立多個試算表檔案: 不要試圖把所有歷史資料和現行資料都放在同一個試算表檔案裡。你可以依據時間(例如:2023年資料、2025年資料),或依據專案(例如:A專案資料、B專案資料),將資料分拆到不同的 Google 試算表檔案中。這樣每個檔案的體積都會小很多,運行起來自然也更輕快。

- 年度、月份、專案劃分: 進一步地,你甚至可以在一個檔案中,用不同的分頁來存放不同月份或不同子專案的資料。但如果單一分頁的列數仍非常龐大,那就需要考慮分檔了。

- 主檔與子檔的策略: 建立一個「主控檔」,裡面可能只存放一些總結性數據或是各子檔的連結。實際的明細資料則分散在多個「子檔」中。需要時,再透過

IMPORTRANGE函數從子檔中拉取部分數據到主控檔進行分析,但要小心IMPORTRANGE在大量使用時的效能問題。

2. 最佳化試算表設計:提升效率的秘密武器

即使資料量大,透過良好的設計習慣,也能顯著提升試算表的運行效率。

- 減少不必要的空白列/欄: 很多人習慣性地在試算表末尾留下大量的空白列,或是預留許多空白欄位。這些空白區域雖然沒有資料,但試算表仍然需要處理它們。適時刪除這些多餘的空白列和欄,能有效減輕檔案負擔。

- 精簡公式與函數使用:

- 善用

ARRAYFORMULA: 如果你的公式需要套用到整欄,盡量使用ARRAYFORMULA來一次性處理。它比把公式拖曳到每一列要有效率得多,因為它只計算一次。 - 優化

QUERY函數:QUERY是個很強大的函數,但如果寫得不好,也會變成效能殺手。盡量在QUERY內部完成篩選、排序、聚合等操作,而不是先用其他函數處理完再丟給QUERY,或從QUERY跑完後再用其他函數。讓它直接針對原始資料做運算。 - 避免揮發性函數: 像是

NOW()、TODAY()、RAND()這些函數,每次打開試算表或每次變動都會重新計算。如果非必要,盡量少用,或者將其結果複製貼上為純值。 - 避免過度使用

IMPORTRANGE: 雖然IMPORTRANGE方便,但它會導致跨檔讀取,增加延遲。如果一個試算表裡有數十個甚至上百個IMPORTRANGE,那跑起來絕對會非常慢。考慮將需要引用的資料,定期複製到同一個試算表的分頁,或是用 Apps Script 定時同步。

- 善用

- 善用資料驗證、條件式格式: 適度使用這些功能可以提升資料的正確性和可讀性,但過度或複雜的條件設定,也會增加試算表的計算負擔。尤其是在數百萬列上設定複雜的條件式格式規則,很可能會讓你的試算表「走不動」。

- 定期清理與維護: 就像整理房間一樣,定期檢查試算表是否有不再使用的公式、臨時分頁或格式設定,清除它們能讓你的檔案保持「輕盈」。

3. 利用進階工具:專業級的資料處理方案

當 Google 試算表真的達到極限,或者你的需求已經超越了試算表本來的定位時,是時候考慮更專業的工具了。

- Google Apps Script 自動化: 對於重複性高、規則明確的資料處理任務,Apps Script 是個寶藏!你可以編寫腳本來自動化資料的匯入、整理、計算、匯出,甚至定時執行。這不僅可以分擔手動操作的負擔,更重要的是,有些 Apps Script 的執行是在 Google 的伺服器端完成,可以比瀏覽器操作更有效率。例如,可以用 Apps Script 定時從一個大檔拉取部分資料到一個小檔,或是在後台進行大量數據處理。

- Google BigQuery 整合: 這是 Google 專為「巨量資料分析」設計的資料倉儲服務。如果你的資料量真的達到數千萬、數億甚至數 TB 的規模,Google 試算表就真的不適合了。將資料導入 BigQuery,你就可以利用 SQL 語法進行超高速的查詢和分析,即使是數十億筆資料也能在幾秒內得出結果。透過 Google 試算表連結 BigQuery,你可以只將查詢後的「結果」導入試算表,而不是整個原始資料。

- Data Studio (現為 Looker Studio) 視覺化: 如果你的主要目的是「報告呈現」和「資料視覺化」,而不是直接在試算表裡操作所有原始資料,那麼 Looker Studio 是個很好的選擇。它可以直接連結 Google 試算表、BigQuery 等多種資料源,然後在 Looker Studio 建立互動式儀表板。這樣,你的試算表可以保持原始、龐大的資料集,而使用者看到的則是精煉、視覺化的報告,既美觀又有效率。

- 樞紐分析表 (Pivot Tables) 進行聚合: 對於需要從大量明細資料中快速提取摘要、趨勢的場合,樞紐分析表絕對是你的好幫手。它可以在不修改原始資料的情況下,快速對資料進行分類、加總、平均等操作,大大減少了需要手動編寫複雜公式的工作量,而且效率很高。

我的經驗談:從實戰中學習如何駕馭巨量資料

我曾經手過一個專案,需要追蹤數十萬筆的線上交易紀錄,每天都會新增上千筆。一開始,我也傻傻地把所有資料都往一個 Google 試算表丟。結果呢?每天早上開機第一件事就是等它載入,點擊篩選鍵要等個半天,隨便改個東西就開始「正在計算…」轉圈圈,整個工作效率直線下降,簡直想撞牆!

後來我痛定思痛,開始學習如何分拆資料。我把每個月的交易紀錄存成一個獨立的 Google 試算表檔案,然後在一個「年度總覽」的檔案中,用 IMPORTRANGE 拉取各月份的摘要數據。這樣一來,每個檔案的負擔都減輕了,日常操作也變得順暢多了。當我需要查看特定月份的明細時,就直接打開那個月份的檔案,處理速度快了不知多少倍!

再後來,當資料量持續爆炸性成長,甚至單一月份的資料也開始變慢時,我開始接觸 Google Apps Script。我寫了一個小腳本,每天自動從原始資料庫匯入最新的數據到當月的試算表,並清理一些舊資料,確保試算表的大小維持在一個合理的範圍內。甚至,我還用 Apps Script 定時將數據匯總後,自動更新到 Looker Studio 的儀表板上,這樣老闆們只需要看儀表板,而不需要直接打開那個龐大的試算表了。

這些經驗讓我深刻體會到,工具的上限不是用來限制你的,而是用來提醒你「是時候考慮更有效率的策略了」。當資料量達到一定規模,適時地調整思路、學習新工具,才是王道。

常見問題與專業解答

Google 試算表的總儲存空間上限是多少?

這個問題的答案其實有些混淆,因為它涉及到「Google 試算表本身」和「你的 Google 雲端硬碟總空間」。

首先,就單一 Google 試算表檔案而言,它的內部限制是1000 萬列。雖然以前有「總儲存格數量」的限制,但現在 Google 主要是以列數作為主要限制指標。這是一個非常龐大的數字,一般情況下,你不太可能在免費的 Google 帳號下達到這個列數,就已經把你的 Google 雲端硬碟空間吃光了。

其次,你所有 Google 檔案(包括試算表、文件、簡報、照片等)的總儲存空間,是受限於你的 Google 雲端硬碟容量的。免費帳戶通常有 15 GB 的空間。雖然 Google 試算表檔案本身佔用的空間相對較小(尤其是純文字和數字的資料),但如果你的試算表裡包含大量圖片、嵌入的檔案或非常複雜的格式設定,它們也會佔用空間。一旦你的雲端硬碟空間用完,你就無法再建立新的檔案或上傳資料了。所以,即使單一試算表沒有達到 1000 萬列,你的總雲端硬碟空間也可能先滿。

如果我的資料超過 1000 萬列,還有其他選擇嗎?

當然有!當你的資料量真的超越了 Google 試算表的負荷能力時,這表示你的需求已經超出了它作為一個「試算表」的範疇,而更接近於「資料庫」或「數據倉儲」的需求了。這時候,你會需要考慮以下這些更專業的工具:

- Google BigQuery: 這絕對是首選!BigQuery 是 Google Cloud 專為巨量資料分析設計的無伺服器、高度可擴展的企業級資料倉儲。它可以處理數 TB 甚至數 PB 級的資料,並且透過 SQL 語法進行超高速查詢。它與 Google Workspace 生態系完美整合,你可以輕鬆地將 BigQuery 的查詢結果匯入 Google 試算表進行進一步處理或視覺化。

- 傳統關聯式資料庫(如 MySQL, PostgreSQL): 如果你對資料庫有基礎知識,或你的應用程式已經在使用傳統資料庫,那麼將資料儲存在這些資料庫中,並透過程式進行操作和查詢,會是更穩健的選擇。它們提供更強大的資料管理、索引和查詢優化功能。

- NoSQL 資料庫(如 MongoDB, Firestore): 對於非結構化或半結構化資料,NoSQL 資料庫可能更適合。它們在處理高併發讀寫和彈性資料模型方面有獨特的優勢。

- 其他雲端數據倉儲(如 Amazon Redshift, Snowflake): 如果你的基礎設施不在 Google Cloud 上,或有其他偏好,這些雲端資料倉儲服務也提供類似 BigQuery 的巨量資料處理能力。

總之,超過 1000 萬列時,代表你的資料管理策略需要升級了,從單純的試算表操作轉向更系統化的資料庫管理和分析。這通常也是企業成長過程中一個重要的轉捩點。

列數限制會影響 Apps Script 的運行嗎?

是的,絕對會!Google Apps Script 在處理巨量資料時,非常容易受到列數限制和相關效能問題的影響。主要有以下幾個方面:

- 執行時間限制: Apps Script 的腳本有執行時間限制,通常是 6 分鐘(對於免費帳戶或標準配額而言)。如果你用腳本去讀取、寫入數百萬列的資料,即使操作本身很簡單,光是資料傳輸和處理的時間,就很容易超過這個限制,導致腳本中斷。

- 記憶體限制: 腳本運行時會佔用一定的記憶體。當你要一次性讀取整個龐大試算表的資料到記憶體中進行處理時(例如使用

SpreadsheetApp.getActiveSpreadsheet().getDataRange().getValues()),很容易耗盡 Apps Script 的記憶體配額,導致腳本失敗。 - 讀寫次數配額: Apps Script 對於試算表的讀寫操作次數也有一定的配額限制。頻繁地在巨量資料中讀寫單個儲存格或小範圍資料,可能導致配額用盡。

因此,在使用 Apps Script 處理大數據時,我們需要採取一些最佳實踐:

- 分批處理: 不要一次性處理所有資料。將任務分解成小批次,例如每次處理 1 萬列,然後重複執行。

- 優化讀寫操作: 盡量減少對試算表的讀寫次數。一次性讀取一個範圍的資料(

getValues()),在記憶體中處理完後,再一次性寫回(setValues()),而不是迴圈地讀寫單個儲存格。 - 利用觸發器: 對於需要長時間運行的任務,可以利用 Apps Script 的「可安裝觸發器」(Installable Triggers),例如時間驅動的觸發器,讓腳本在背景定時執行。如果一個腳本會超時,可以將其拆分為多個獨立的腳本,並透過觸發器鏈接執行,或者在腳本中加入計時器,當接近時間限制時,儲存進度並重新啟動下一個批次。

- 直接與 BigQuery 互動: 如果你的資料已經在 BigQuery 中,Apps Script 可以直接透過 BigQuery API 與之互動,執行查詢並將結果直接導出,這比透過 Google 試算表作為中介要高效得多。

我要怎麼知道我的 Google 試算表現在有幾列資料?

想要快速知道你的 Google 試算表有多少列資料,有幾種很方便的方法:

- 快速鍵跳轉: 這是最常用也最快速的方法。

- 在 Windows 上:按下

Ctrl + End。你的游標會立即跳轉到你試算表中「最後一個有資料的儲存格」。這時候,你可以看左側的列數編號,就知道你的資料有多少列了。 - 在 macOS 上:按下

Command + ↓(向下箭頭)。這會讓游標從你當前位置跳到該欄最下方的資料列。如果從 A1 開始按,就能迅速跳到最後一列資料。

- 在 Windows 上:按下

- 捲軸觀察: 當你的試算表資料很多時,右側的垂直捲軸會變得非常小。拉動捲軸到底部,通常會顯示出最大的列號。不過這種方法不太精確,因為可能會有空白列。

- 使用公式: 如果你想要在試算表內部顯示資料的總列數(例如在儀表板中顯示),你可以使用一些簡單的公式:

=COUNTA(A:A):這個公式會計算 A 欄中有多少個非空儲存格。如果你的資料是連續的,沒有中間的空白列,這個公式就能給你一個很好的近似值。但要注意,它會把欄位標題也算進去,所以可能需要減 1。=MAX(ARRAYFORMULA(ROW(A:A)*(A:A<>""))):這個公式會找到 A 欄最後一個非空儲存格的列號。這是一個更精確的方法,可以忽略中間的空白列,直接找到最底部的資料列。=ROWS(UNIQUE(FILTER(A:A, A:A<>""))):這個是計算不重複的非空資料列數。

- 查看試算表資訊: 在某些情況下,尤其是當檔案非常龐大時,Google 試算表會在右下角或底部狀態欄顯示一些檔案的資訊,但這不是常態性的顯示資料列數。

我個人最推薦使用 Ctrl + End 或 Command + ↓,既快速又直觀。如果需要動態顯示,就用 MAX(ARRAYFORMULA(ROW(A:A)*(A:A<>""))) 這樣的公式。

Google 試算表適合所有的大數據分析需求嗎?

簡短的回答是:不,它不適合所有的大數據分析需求。

Google 試算表雖然功能強大,對於中小型資料集(數千到數十萬列)來說是一個極佳的工具,它易於上手、協作方便、整合度高。但當面對真正的「大數據」時,它的局限性就會變得非常明顯。

以下是一些情境,說明 Google 試算表何時「不適合」大數據分析:

- 資料量級: 當資料量達到數千萬列、數億列,甚至數 TB 或數 PB 級別時,Google 試算表會變得極度緩慢甚至無法使用。這時候需要 BigQuery、Hadoop 等專為巨量資料設計的系統。

- 複雜查詢與性能: 如果你需要執行非常複雜的跨表連接(JOIN)、嵌套查詢、聚合操作,並且要求在毫秒或秒級別內返回結果,Google 試算表的查詢引擎是無法滿足的。資料庫系統(SQL 或 NoSQL)或數據倉儲能提供更優化的查詢性能。

- 資料模型與關聯: Google 試算表本質上是二維的表格結構。如果你需要處理多個表格之間複雜的關聯性,建立正規化的資料模型,試算表會顯得力不從心,容易產生資料冗餘和不一致。這時候關聯式資料庫是更好的選擇。

- 實時數據流處理: 對於需要即時處理高速傳入的數據流(例如物聯網感測器數據、即時交易數據),Google 試算表根本無法應對。這需要專門的流處理系統(如 Apache Kafka, Google Cloud Dataflow)。

- 資料安全與權限管理: 雖然 Google 試算表有分享權限設定,但對於企業級的精細化權限管理、資料加密、審計日誌等安全需求,專業的資料庫系統提供更全面、更嚴格的控制。

- 自動化與整合: 雖然 Apps Script 可以提供一定程度的自動化,但對於大規模的數據管道(ETL)、與多個複雜系統的深度整合,資料庫和雲端數據平台會提供更豐富的 API 和工具生態系。

我的建議是,將 Google 試算表定位為「資料的最終呈現層」或「中小型資料的快速處理工具」。它可以是你的數據分析旅程的「終點站」(展示儀表板),或是「中繼站」(從數據倉儲拉取部分資料做進一步分析),但不應該是巨量資料的「儲存中心」和「主要分析引擎」。學會什麼時候該放手,轉向更適合的工具,是數據工作者的重要技能之一。

結論:擁抱 Google 試算表,更要理解它的界限

Google 試算表從最初的百萬儲存格,一路進化到現在的 1000 萬列,這無疑是一個巨大的進步,也展現了 Google 持續投入和優化產品的決心。對於絕大多數的個人使用者、學生,甚至是中小型企業來說,這個容量已經綽綽有餘,完全能夠滿足日常的數據管理、報告製作和簡單分析的需求。

然而,就像任何工具一樣,Google 試算表有其強項,也有其界限。它在易用性、協作性、與 Google 生態系的整合性方面表現卓越,但當我們真的面臨「巨量資料」的挑戰時,它的效能瓶頸就會浮現。理解這些限制並不是要我們放棄使用 Google 試算表,而是要我們更聰明地使用它。

學會如何分拆資料、優化試算表結構、善用 Apps Script 自動化,以及在必要時果斷地轉向 BigQuery 或其他專業數據工具,這些都是駕馭現代數據環境不可或缺的技能。將 Google 試算表視為你數據工具箱中的一把「瑞士刀」:它功能多樣、方便攜帶,但當你需要「電鋸」或「起重機」時,也要知道何時該換工具。這樣一來,無論資料規模多大,你都能游刃有餘地處理,讓數據真正成為你工作的助力,而不是阻力!